Соцінженерія

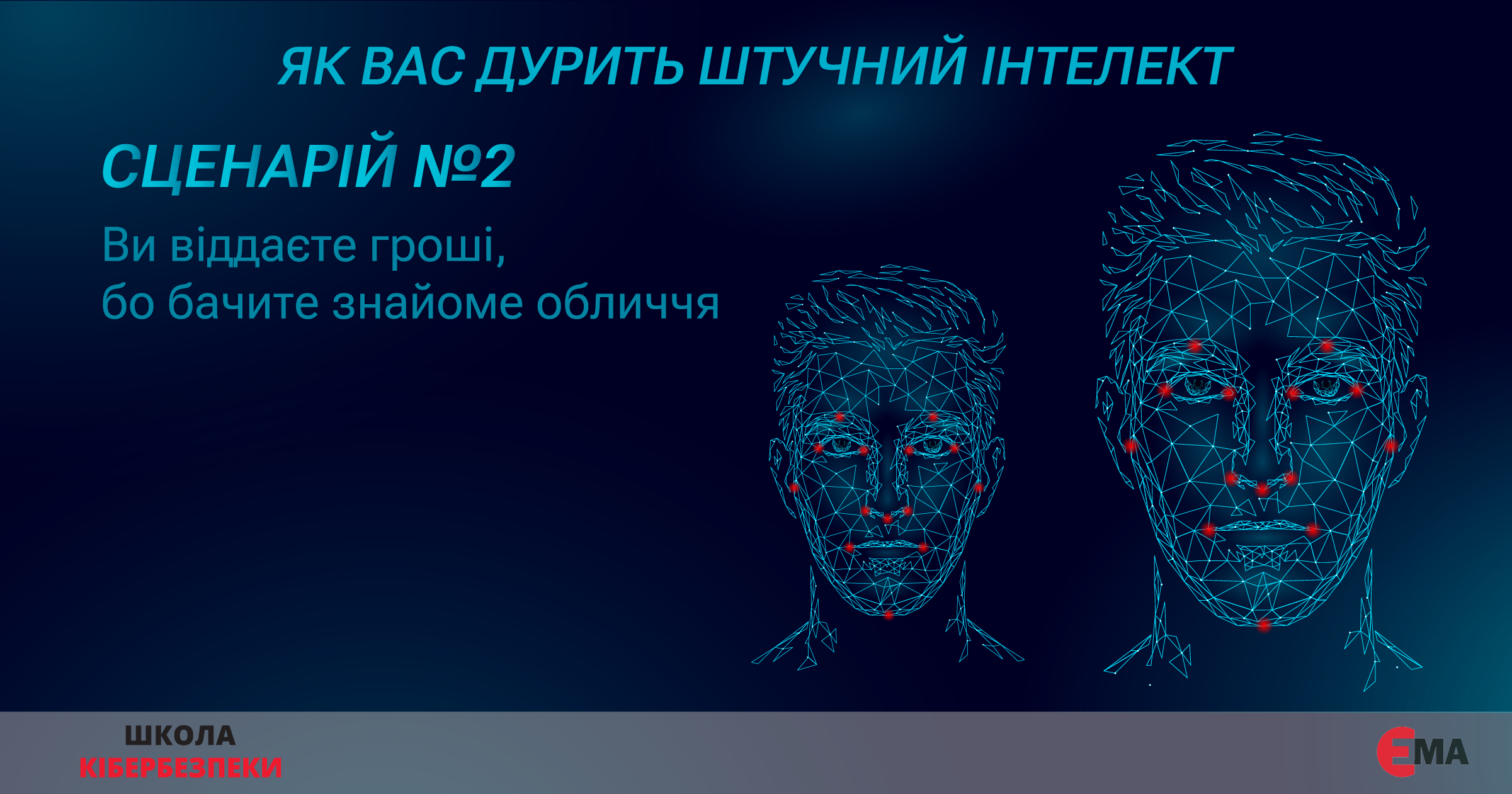

Як вас дурить штучний інтелект. Cценарій №2: Ви віддаєте гроші, бо бачите знайоме обличчя

Після шахрайства з використанням аудіо-дипфейків, про яке ми розповідали у першому сценарії серії постів «Як вас дурить штучний інтелект», — час поговорити про ще більш витончену схему шахрайства з використанням штучного інтелекту. ШІ навчився підробляти не лише аудіо, але й відео — і робить це настільки переконливо, що навіть обізнані у кібербезпеці українці можуть потрапити у пастку.

Київ, лютий 2025

Співробітниця української компанії пізно ввечері отримала повідомлення в Telegram від свого керівника з проханням допомогти грошима — мовляв, термінова ситуація, і він звертається до всіх колег. Жінка попросила підтвердити особу. За кілька хвилин їй надійшло відео-повідомлення («кружечок» в Telegram), на якому директор особисто просив її про допомогу. Переконана у справжності звернення, вона переказала 20 000 грн на вказаний рахунок. У понеділок з’ясувалося: директор нічого не просив, його акаунт було зламано, а відео виявилось діпфейком, згенерованим на основі його старих відеоповідомлень у месенджері.

5 фактів, які змушують насторожитися:

- 3000% — саме настільки зросла кількість спроб обійти верифікацію особи за допомогою діпфейків у 2024 році (Onfido).

- Лише 57% людей здатні розпізнати діпфейк-відео — решта помиляються (PNAS).

- 8 хвилин — стільки часу потрібно, щоб створити переконливий відеофейк (NPR).

- 45% людей відповіли б на діпфейк-повідомлення «від знайомого», не перевіривши його справжність (McAfee).

- 400 компаній щодня стають мішенню діпфейк-звернень від керівника до співробітників (Business.com)

Як розпізнати відео–діпфейк?

Зверніть увагу на ознаки штучно згенерованого відео:

- неприродна міміка, повільне або відсутнє моргання;

- невідповідність рухів губ звуковому ряду;

- замилене або пікселізоване зображення обличчя;

- неприродні тіні, різниця у відтінках шкіри на обличчі, шиї та руках;

- надто наближене обличчя в кадрі (щоб не було видно шиї або плечей);

- відмова виконати просте прохання — помахати руками перед обличчям.

⚠️ Застереження: раніше прохання “помахати руками перед камерою” допомагало викрити фейк. Але сучасні інструменти штучного інтелекту вже здатні генерувати відео в реальному часі, не допускаючи спотворень навіть при активних рухах рук перед обличчям.

За статистикою, найчастіше українці стикаються з відео-діпфейками, в яких використовуються обличчя публічних осіб:

- Ілона Маска — у шахрайських крипторозіграшах та псевдоінвестиційних схемах;

- Алли Мазур — у фейкових відео з нібито «державними виплатами» на суму 6–12 тисяч гривень;

- Володимира Зеленського — у відеофейках із заголовками на кшталт «Додаткові тисячі від Зеленського».

Але найнебезпечніші діпфейки — це ті, в яких підроблюють обличчя ваших колег, друзів та керівників. Бо саме їм ми найчастіше довіряємо — без додаткової перевірки.

Що робити, якщо вам пише або надсилає відео-повідомлення знайома людина з проханням позичити гроші?

- Зв’яжіться з нею іншим каналом зв’язку — телефоном, через інший месенджер або особисто. Уточніть, чи справді вона зверталася до вас.

- Задайте перевірочне запитання, відповідь на яке знає лише ця людина. Це може бути особистий факт, спільний спогад або деталь, яка не відома стороннім і не згадується у вашому листуванні в месенджері.

- Ніколи не надсилайте гроші лише через “знайоме обличчя”. Обличчя легко підробити, акаунти — зламати.

Пам’ятайте: ШІ вже тут. І він вміє виглядати як ваш знайомий.

Це лише другий сценарій шахрайства з використанням штучного інтелекту. Попереду — інші, ще хитріші.